스케일AI, 구글 독스를 통한 기밀 정보 유출로 보안 논란 확산

메타·구글 등 고객사 정보 포함된 문서 수천 개 외부에 노출

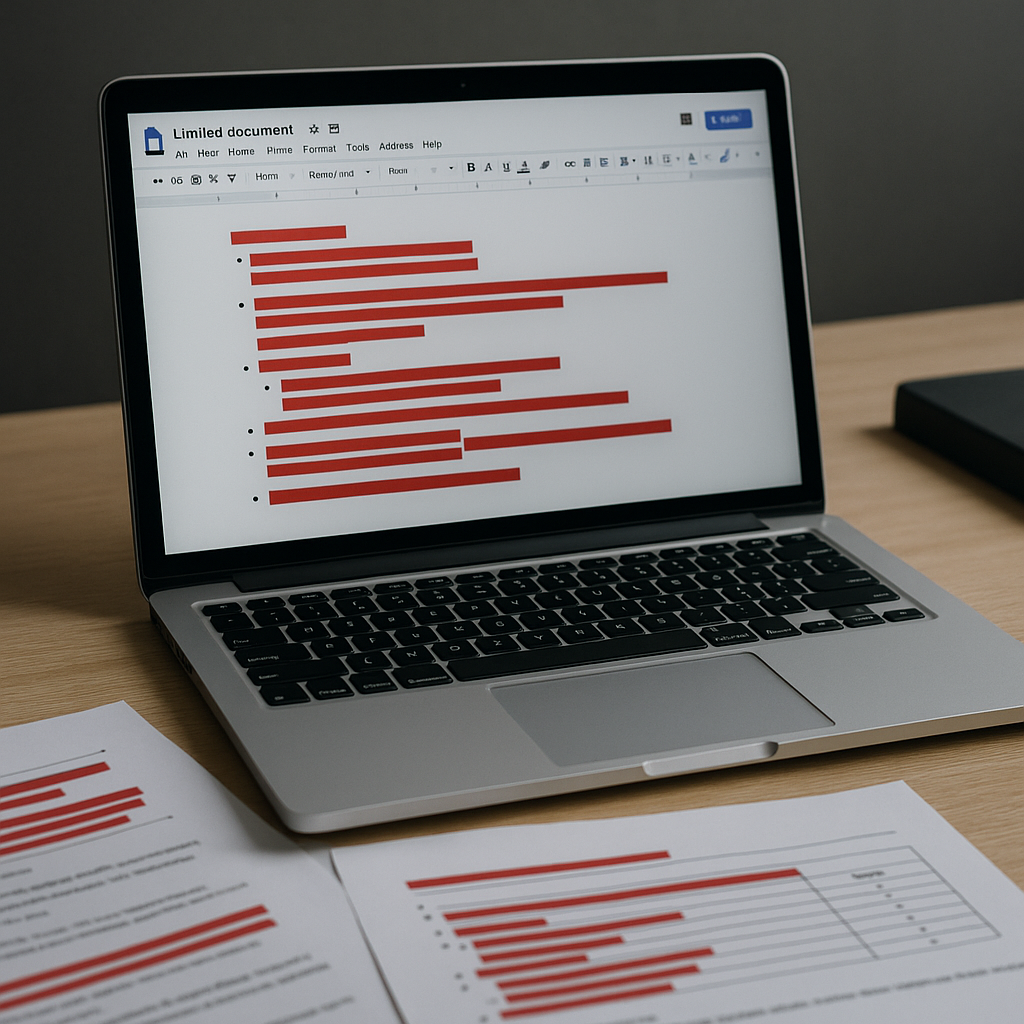

인공지능 데이터 라벨링 서비스를 제공하는 미국의 스타트업 스케일AI(ScaleAI)가 고객사의 기밀 정보를 담은 수천 건의 구글 독스를 외부에 공개된 상태로 방치해온 사실이 드러나면서 심각한 보안 논란이 일고 있다. 비즈니스 인사이더의 보도에 따르면, 해당 문서는 단순히 링크만 있으면 누구나 접근할 수 있는 설정으로 운영되어 왔으며, 이로 인해 메타 플랫폼스(Meta Platforms), 구글(Google), 일론 머스크의 xAI 등 주요 고객사들의 민감한 프로젝트 정보가 외부에 유출되는 사태가 발생했다.

유출된 자료는 각 기업의 AI 개발 전략, 음성 데이터 샘플, 챗봇 성능 개선 계획 등 구체적인 기술적 내용이 포함되어 있었다. 예를 들어, 구글의 AI 챗봇 바드(Bard, 현재는 제미나이)의 성능을 개선하기 위해 챗GPT를 비교 분석한 전략 문건, 메타가 운영 중인 21개 생성 AI 프로젝트의 세부 내용과 음성 데이터 링크, 그리고 xAI의 '프로젝트 실로폰(Project Xylophone)'의 훈련 가이드라인 데이터 등도 구글 독스에 포함돼 있었다.

더욱 우려되는 점은 스케일AI와 계약한 외부 인력의 개인정보까지 함께 유출됐다는 사실이다. 구글 독스를 통해 수천 명의 프리랜서 라벨러들의 이메일 주소, 실명, 평가 결과가 포함된 문서가 확인됐으며, 일부 문서에서는 ‘부정행위자’, ‘품질 낮음’ 등의 내부 분류가 명시돼 있었다. 심지어 “좋은 인력과 나쁜 인력”이라는 이름의 스프레드시트도 확인된 바 있다.

스케일AI는 업무 효율성과 협업 강화를 위해 구글 독스를 광범위하게 사용해왔던 것으로 보인다. 그러나 이 과정에서 기초적인 보안 설정조차 제대로 이루어지지 않았다는 점이 지적되고 있다. 내부 관계자에 따르면, 일부 문서는 ‘confidential’이라는 제목이 붙어 있었음에도 불구하고 제한 없이 외부 접근이 가능하도록 설정돼 있었던 것으로 드러났다. 이에 따라 정보 유출 범위는 단순한 기술 문서를 넘어 고객사의 전반적인 프로젝트 기획 단계까지 포함되는 것으로 분석된다.

현재 스케일AI는 유출 사실을 인지하고 문제 해결에 나섰으며, 모든 공개 문서의 공유 기능을 비활성화하고 내부 조사를 진행 중이라고 밝혔다. 해당 기업은 뉴욕 포스트를 통해 철저한 검토와 함께 재발 방지를 위한 조치를 약속한 상태다. 그러나 이미 구글 등 일부 고객사는 스케일AI와의 계약 관계를 재검토하거나 일시 중단하는 조치를 취한 것으로 알려졌으며, 이로 인해 스케일AI의 신뢰도와 향후 사업 전망에 부정적인 영향이 불가피할 것으로 보인다.

이번 사건은 AI 산업의 급속한 발전 속에서도 데이터 보안에 대한 체계적 관리가 얼마나 중요한지를 여실히 보여주는 사례로 분석된다. 특히 AI 개발의 핵심 단계인 데이터 라벨링과 가공 과정에서 다수의 외부 인력이 관여하게 되면서, 이들의 정보와 고객사 자료가 함께 노출될 위험이 상존한다는 점을 명확히 드러냈다. 향후 유사한 서비스를 제공하는 기업들 역시 내부 보안 프로토콜을 강화하고, 문서 접근 제어에 대한 기준을 재정립할 필요성이 제기되고 있다.

스케일AI는 AI 데이터 인프라 제공을 통해 급격히 성장한 기업으로, 최근 메타로부터 143억 달러에 달하는 대규모 투자를 유치한 바 있다. 그러나 이번 사건으로 인해 기업의 평판과 고객사 확보에 상당한 타격이 불가피할 것으로 전망된다. AI 산업이 확장되는 만큼, 그 기반이 되는 데이터 보안 역시 함께 강화되어야 할 필요성이 부각되고 있다.